在 BISHENG 中的使用

本文将以智算平台上大模型服务中的 DeepSeek-R1-Distill-Qwen-7B 和 bce-embedding-base_v1 为例,向用户介绍如何在毕昇 BISHENG 中添加并使用CoresHub平台提供的模型服务。

背景信息

毕昇 BISHENG 是一款领先的开源大模型应用开发平台,赋能和加速大模型应用开发落地,帮助用户以最佳体验进入下一代应用开发模式。毕昇 BISHENG基于 Apache 2.0 License 协议发布,于 2023 年 8 月底正式开源。

毕昇 BISHENG 具有如下功能特点:

-

独具特色的工作流及应用编排框架。

-

内置多个企业场景应用。

-

完善的知识库场景功能。

-

高精度文档解析能力。

-

多个模型平台快速接入。

-

完善的企业级特性。

-

易用的界面和 API 接口。

前提条件

用户已下载并安装毕昇。

操作步骤

获取 API 密钥和域名

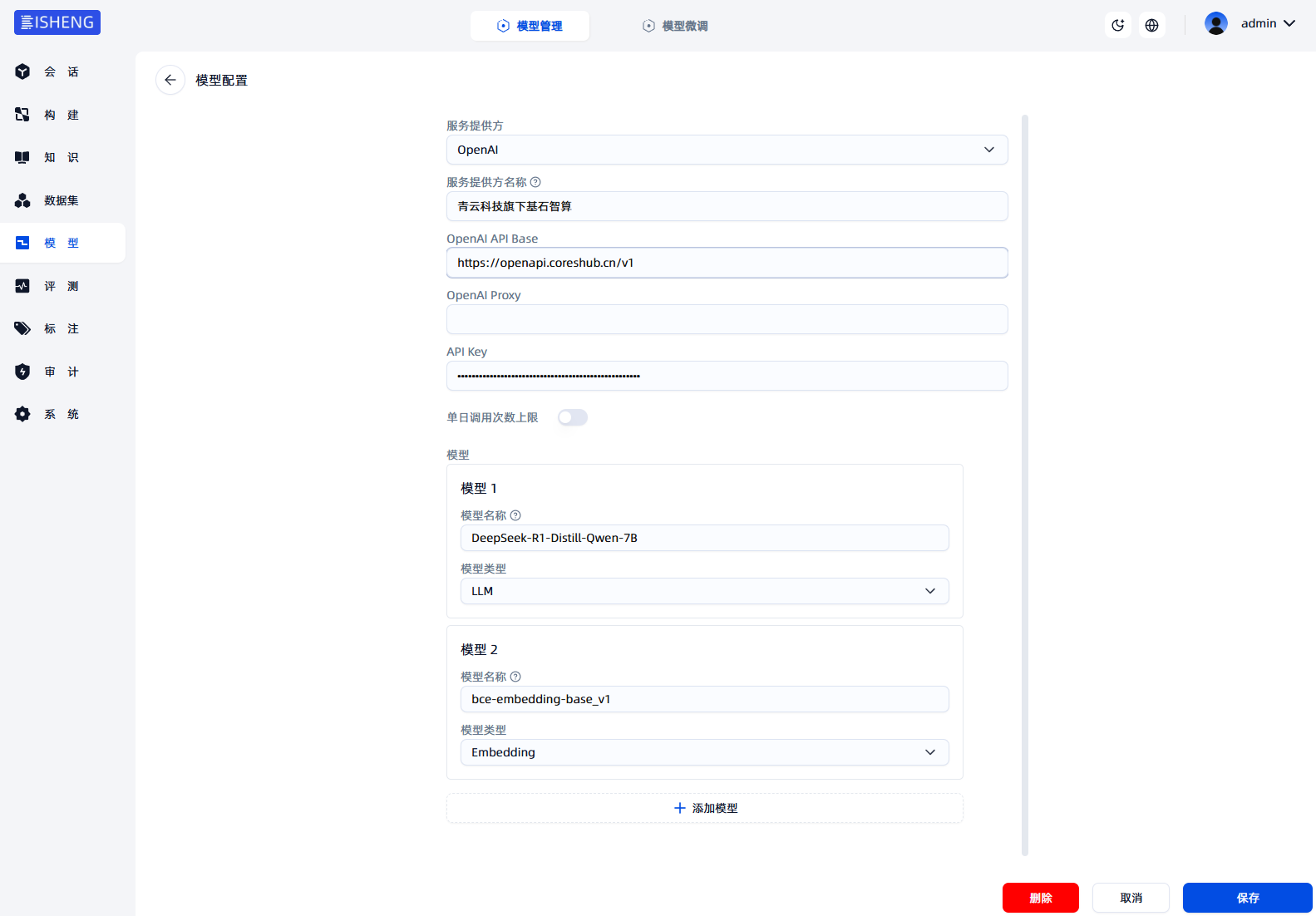

配置模型服务

-

访问 BISHENG 系统地址,输入账户密码后登录。

-

在左侧导航栏,选择模型,并点击右上角的添加模型按钮。

-

在弹出界面中,根据页面提示配置各项参数并添加模型后,点击保存即可。

说明 -

若使用 RAG 或知识库功能,用户需要添加嵌入模型,目前智算平台上的嵌入模型为

bce-embedding-base_v1。 -

如需要继续添加其他模型,则继续点击下方的添加模型按钮即可。

-

模型提供方:选择 OpenAI 即可。 -

模型提供方名称:用户自定义。 -

OpenAI API Base:填写为https://openapi.coreshub.cn/v1。 -

OpenAI Proxy:保持为空即可。 -

API Key:用户在获取 API 密钥和域名操作中复制得到的完整 API 密钥,需根据实际情况进行修改。 -

添加模型:点击配置页面下方的添加模型,配置模型名称和模型类型,模型需逐个添加每次添加一个。本实践中需添加DeepSeek-R1-Distill-Qwen-7B和bce-embedding-base_v1故参数填写如下:-

模型名称

DeepSeek-R1-Distill-Qwen-7B对应的模型类型选择LLM。 -

模型名称

bce-embedding-base_v1对应的模型类型选择Embedding。

-

-

配置系统模型

-

延续前文操作,点击右上角系统模型设置。

-

选择知识库模型页签,配置知识库默认

Embedding模型和其他相关知识库模型,点击保存。

-

选择助手模型,配置助手推理模型和助手自画像自动优化模型,点击保存。

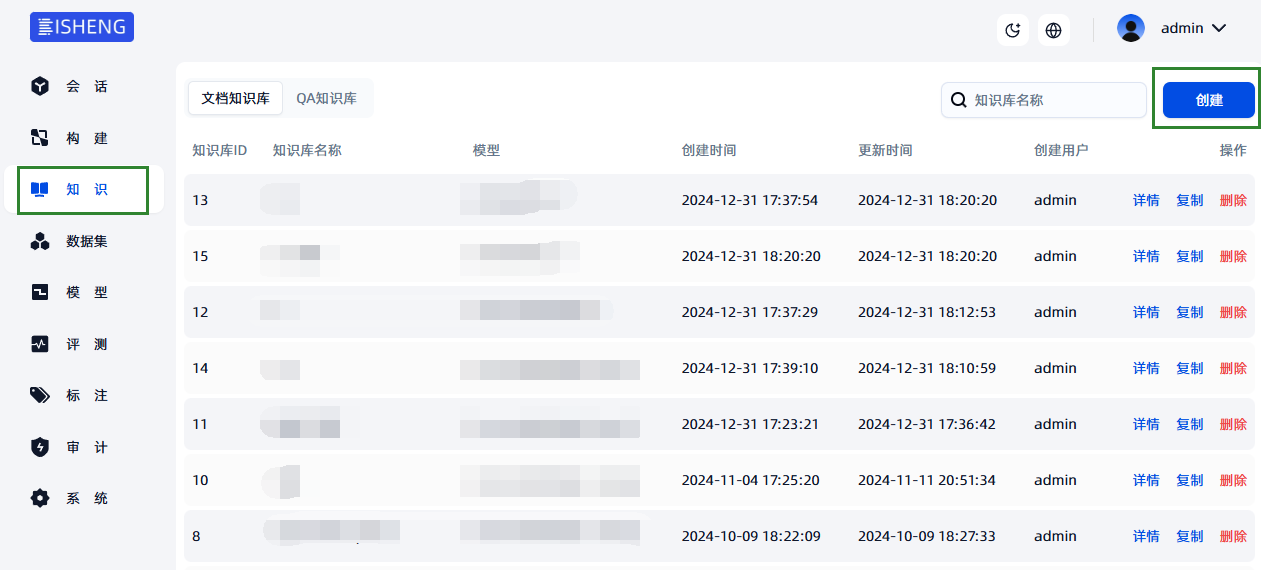

创建知识库

-

延续前文操作,在左侧导航栏中,选择知识,并点击右上角创建。

-

在弹出的创建知识库窗口中,输入如下各项参数,点击创建。

-

知识库名称:用户自定义。 -

描述:用户基于实际需求自行填写或为空。 -

模型:本实践中选择添加的嵌入模型为bce-embedding-base_v1。

-

-

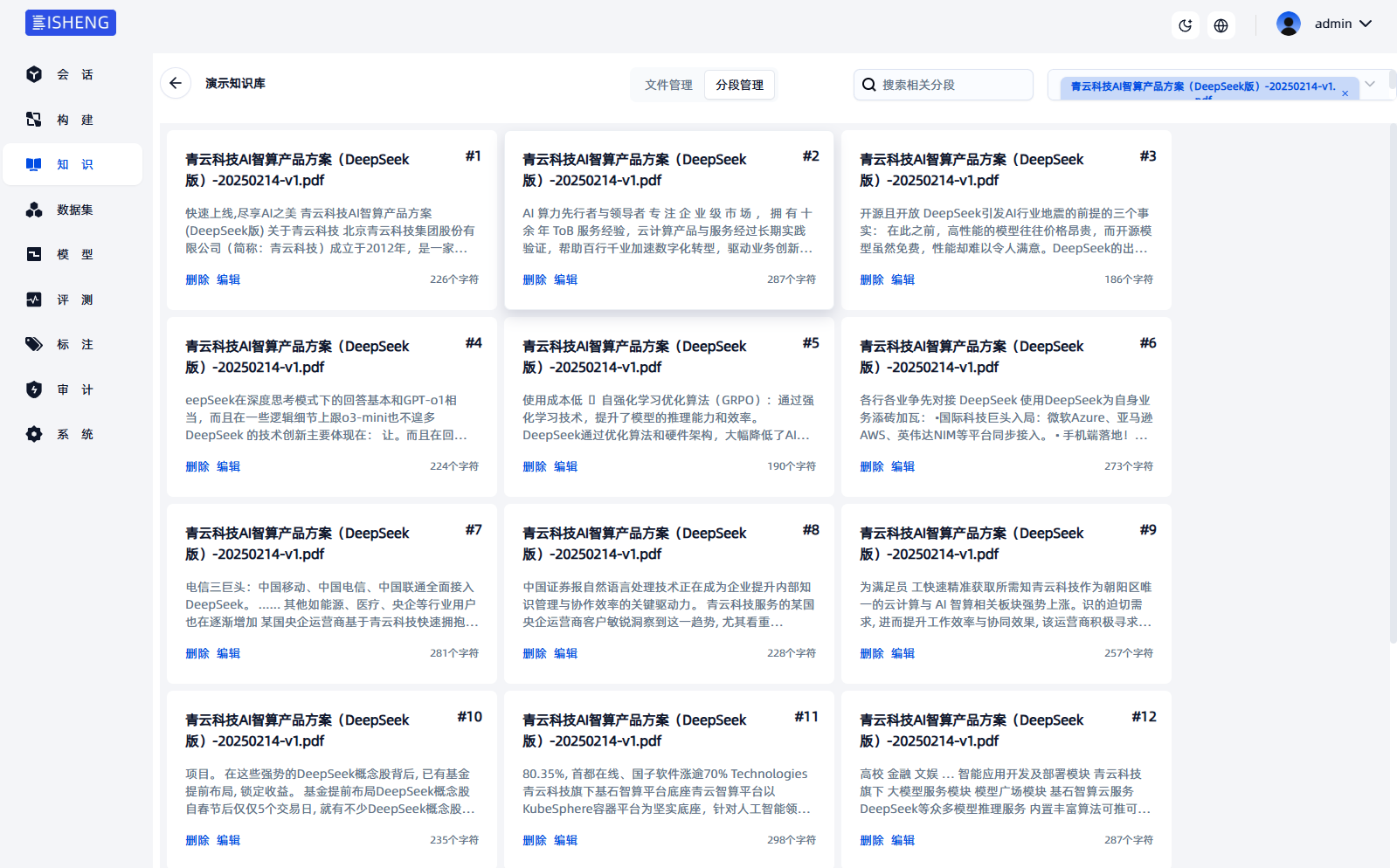

完成知识库的创建后,进入文件上传页面,根据需求上传相应文件,点击下一步。

-

进入文档处理策略配置页面,选择自定义策略,选中所有切分方式、切分长度为 300、重叠区长度为 100,点击提交即可等待解析。

-

等待解析完成,可点击详情查看分段内容。

构建应用

-

在左侧导航栏,选择构建,并点击新建应用。

-

在弹出的窗口中,选择新建工作流,输入名称和描述信息,点击创建。

-

返回主界面,点击右上角的

,选择导入工作流,并将工作流文件导入。

,选择导入工作流,并将工作流文件导入。说明 本实践的工作流

.json文件,可点击此处下载获取。 -

配置搜索范围和模型,依次点击保存和上线即可。

-

搜索范围:选择前文中创建好的知识库。 -

模型:选择前文中配置的模型即可。

-

-

关闭配置页面,返回系统首页,在会话界面中,选择上一步创建的基石智算小助手工作流,即可开始对话。